La clave para resolver la recuperación lenta de archivos muy grandes está en un enfoque de varios frentes: modernizar la infraestructura física, ajustar con precisión las políticas de crecimiento de archivos lógicos y aplicar estrategias de fragmentación inteligente. Para mejorar este problema, habrá que reducir el número de Archivos de Registro Virtuales (VLFs) en las bases de datos, optimizar el ancho de banda de red con protocolos de transferencia rápida y migrar a sistemas de almacenamiento con baja latencia, como unidades NVMe. Si se trata al mismo tiempo la fragmentación del sistema de archivos y los cuellos de botella del hardware, las organizaciones pueden convertir procesos de recuperación de horas en tareas que solo tardan unos minutos.

En la actualidad, con un crecimiento de datos explosivo, la gestión de activos grandes -como bases de datos de muchos terabytes, videos 8K o conjuntos de datos para inteligencia artificial- presenta retos específicos. A menudo, las empresas usan soluciones de almacenamiento en la nube gratis para reducir riesgos a corto plazo, integrando servicios como almacenamiento en la nube gratis para mantener disponibles sus activos más importantes mientras mejoran sus infraestructuras locales. Sin embargo, el rendimiento no se arregla con una sola acción, sino con un proceso continuo de ajustes técnicos y decisiones estratégicas.

¿Qué significa la recuperación lenta de archivos en activos grandes?

La recuperación lenta de archivos es el retraso excesivo que se produce cuando un sistema intenta leer, restaurar o volver a poner en línea un archivo muy grande después de un cierre inesperado, una migración o una restauración desde backup. En activos grandes, este problema no se mide solo por la velocidad de transferencia, sino por el tiempo que el sistema invierte en analizar metadatos y reconstruir índices antes de que el archivo vuelva a ser útil para el usuario.

Cuando hablamos de “activos grandes”, nos referimos a archivos cuyo tamaño supera lo que un sistema operativo estándar puede procesar con rapidez. Estos activos suelen requerir un manejo especial porque su estructura interna es más compleja. Por ejemplo, una base de datos de varios terabytes no es solo un bloque de información; es una red compleja de registros, transacciones y punteros que se deben validar para mantener la integridad de los datos durante la recuperación.

Principales síntomas de recuperación lenta

Uno de los síntomas más claros es el bloqueo aparente del proceso durante las fases de “rehacer/deshacer” (redo/undo). En motores de base de datos como SQL Server, es habitual ver mensajes que indican que el análisis sigue al 0% tras varios minutos. Este punto muerto suele indicar que el sistema está lidiando con demasiados metadatos o con una fragmentación lógica tan alta que impide una lectura secuencial eficiente.

Otro síntoma importante es el uso máximo de recursos de hardware, como CPU o disco, sin que aumente realmente la salida de datos. Esto muestra que el procesador está atrapado en tareas internas de gestión de estructuras de archivos en lugar de transferir datos útiles. Además, los usuarios pueden sufrir tiempos de espera (timeouts) en las aplicaciones que dependen de esos archivos, lo que interrumpe la actividad de la empresa y empeora la experiencia general del usuario.

Diferencias entre recuperación en archivos pequeños y grandes

La diferencia principal está en el impacto de la carga administrativa. En archivos pequeños, el sistema operativo gestiona la tabla de asignación de forma casi instantánea. En activos grandes, cualquier pequeña ineficiencia se amplifica. Por ejemplo, una fragmentación del 5% en un archivo de 10 MB pasa desapercibida; el mismo 5% en un archivo de 10 TB implica miles de movimientos extra del cabezal en discos mecánicos o miles de operaciones de búsqueda adicionales en unidades de estado sólido.

Además, los activos grandes suelen estar sujetos a políticas de registro de transacciones más estrictas. Mientras que un archivo pequeño puede recuperarse copiándolo sin más, un activo grande -sobre todo en entornos corporativos- exige validar su consistencia interna. Esto hace que el tiempo de recuperación no crezca de forma proporcional al tamaño, sino de forma descontrolada si no se aplican buenas prácticas, lo que convierte su gestión en una tarea técnica especializada.

Factores que afectan el rendimiento de recuperación de archivos grandes

El rendimiento al recuperar activos muy grandes depende de una cadena de factores conectados. Si uno de ellos falla o es poco eficiente, se produce un efecto dominó que ralentiza todo el proceso. Entender estos factores es el primer paso para crear una estrategia eficaz que ofrezca tiempos de respuesta rápidos y estables.

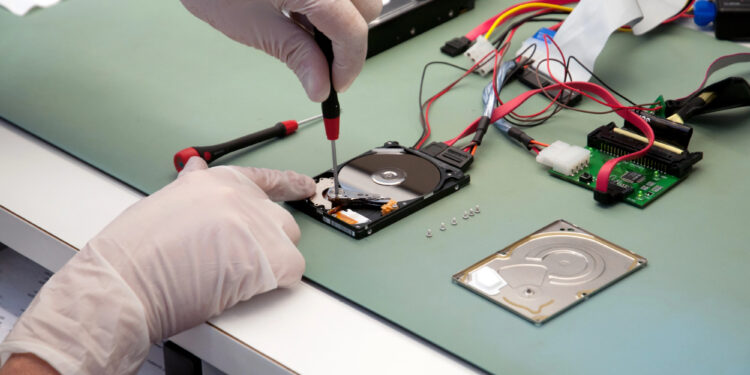

Limitaciones del hardware y la infraestructura

El hardware es la base del rendimiento. Usar discos duros mecánicos (HDD) para activos grandes es hoy uno de los mayores problemas, por sus bajas velocidades de entrada/salida (I/O) y sus altos tiempos de búsqueda. El paso a unidades de estado sólido (SSD) y, mejor aún, a tecnología NVMe es clave. Esta última permite procesar datos en paralelo, algo esencial para leer grandes bloques de información al mismo tiempo.

La memoria RAM también es pieza clave. Un sistema con poca memoria obligará al motor de recuperación a intercambiar datos con el disco (swapping) de forma constante, lo que dispara la latencia. Para activos grandes, la infraestructura debe disponer de suficiente caché para guardar las tablas de metadatos e índices más usados, de modo que el procesador pueda acceder a ellos en nanosegundos en lugar de milisegundos.

Impacto de la red y el ancho de banda

En entornos donde los activos grandes se recuperan desde servidores remotos o almacenamiento en red (NAS/SAN), la red se convierte en el factor más importante. Una red de 1 Gbps, aunque sea el estándar, se queda corta para mover archivos de varios terabytes en tiempos razonables. La latencia y la pérdida de paquetes pueden dañar el flujo de datos y obligar a retransmisiones, lo que duplica o triplica el tiempo de recuperación.

Conviene usar redes de fibra de 10 Gbps o más y protocolos ajustados para alto rendimiento como SMB Direct o iSCSI en redes dedicadas. La congestión por otros procesos que usan el mismo ancho de banda debe reducirse con segmentación de red y priorización del tráfico de recuperación (Calidad de Servicio – QoS), dando siempre preferencia a los activos críticos.

Eficiencia del sistema de almacenamiento

No todos los sistemas de archivos soportan bien los activos enormes. Sistemas antiguos o mal configurados pueden limitar el tamaño máximo de archivo o ser lentos al buscar bloques. Elegir sistemas modernos como ReFS o ZFS puede marcar una gran diferencia, ya que ofrecen funciones de autorreparación y una gestión de metadatos más rápida en archivos grandes. El uso de estos sistemas en combinación con nubes seguras garantiza que, además de rendimiento, los activos cuenten con la máxima privacidad.

La configuración de almacenamiento, como los niveles RAID, también influye mucho. Un RAID 5 aprovecha mejor el espacio, pero su rendimiento de escritura y de recuperación tras un fallo es mucho peor que el de un RAID 10. Para activos grandes donde la velocidad de recuperación es prioritaria, suele ser mejor sacrificar algo de espacio a cambio de una configuración basada en espejado y striping, que ofrece una lectura y restauración mucho más rápidas.

Fragmentación y organización de los archivos

La fragmentación física ocurre cuando las partes de un archivo se almacenan en zonas separadas del disco. En activos grandes, como bases de datos, la fragmentación lógica es igual de dañina. Un ejemplo son los VLFs (Virtual Log Files) en el registro de transacciones de SQL Server. Si un archivo de log crece en incrementos muy pequeños (por ejemplo, 1 MB), se generan miles de VLFs. Durante la recuperación, el sistema tiene que revisar cada uno de ellos, lo que hace el proceso más lento.

La organización interna de los datos también es importante. Los archivos que no siguen un orden lógico secuencial obligan al sistema a usar lecturas aleatorias, que son más lentas que las secuenciales. Mantener una programación de desfragmentación periódica y, sobre todo, configurar bien los tamaños de crecimiento automático ayuda a que los datos sigan siendo contiguos y que la recuperación sea más fluida.

Configuración y políticas del sistema de gestión

Muchas veces, el problema no está en el hardware sino en la configuración del software. Los ajustes por defecto de bases de datos o servidores de archivos suelen estar pensados para usos generales, no para archivos enormes. Por ejemplo, una política de “crecimiento automático” del 10% en un archivo de 1 TB provoca un aumento inmediato de 100 GB, lo que puede bloquear el sistema durante minutos mientras se reserva el espacio.

Las políticas de seguridad y cifrado también añaden carga extra. Si un archivo grande está cifrado con un algoritmo pesado, cada bloque recuperado debe descifrarse en tiempo real, consumiendo muchos ciclos de CPU. Conviene revisar estas políticas para encontrar un punto medio entre la seguridad necesaria y el rendimiento deseado, usando aceleración por hardware para cifrado siempre que se pueda.

Principales causas de la recuperación lenta en archivos de gran tamaño

Encontrar la causa raíz es clave para aplicar la solución correcta. En activos muy grandes, las causas suelen esconderse en procesos rutinarios que, al someterlos a presión, muestran todas sus carencias. Desde métodos de copia de seguridad antiguos hasta errores de configuración, los motivos de una recuperación lenta son variados, pero en general se pueden anticipar.

Procesos de backup y restauración ineficientes

Usar solo copias de seguridad completas (Full Backups) para activos grandes casi garantiza la lentitud. Restaurar desde cero un archivo de 5 TB cada vez que hay un incidente es ineficiente y muy lento. No contar con una estrategia combinada de copias incrementales y diferenciales obliga al sistema a procesar enormes cantidades de datos que no han cambiado desde la última copia.

Además, no probar las restauraciones de forma periódica es una fuente indirecta de lentitud. Es habitual que las copias de seguridad estén muy comprimidas para ahorrar espacio, pero el tiempo de descompresión durante la recuperación y el uso adicional de CPU pueden anular ese ahorro. Si el software de backup no maneja bien la lectura y escritura en varios hilos a la vez (multicanalización), la velocidad de recuperación quedará limitada por el rendimiento de un solo hilo.

Cuellos de botella en el acceso a bases de datos

En bases de datos, problemas como el patrón “N+1” o las consultas mal optimizadas pueden retrasar el regreso a la normalidad del servicio. Si el proceso de recuperación debe validar millones de relaciones entre tablas antes de permitir el acceso, cualquier fallo en la indexación actúa como un muro. Las bases de datos que no han sido analizadas para conocer bien sus patrones de acceso sufren mucho durante las fases de comprobación de consistencia.

El registro de transacciones suele ser otro foco de problemas. Como ya se comentó, una acumulación excesiva de VLFs causada por un crecimiento fragmentado obliga al motor a leer miles de pequeños segmentos antes de abrir la base de datos. Este análisis es administrativo y no mueve datos de usuario, pero es obligatorio para mantener la integridad, por lo que se convierte en un punto crítico de bloqueo.

Problemas de compresión y descompresión de datos

La compresión ahorra espacio y acelera el traslado por red, pero es una carga para la CPU durante la recuperación. Si se elige un algoritmo con nivel de compresión muy alto (como algunos modos “Ultra”), el procesador puede convertirse en el elemento más lento, dejando disco y red casi sin uso mientras intenta descomprimir los datos.

También hay problemas de compatibilidad entre algoritmos o versiones. Si un activo se comprimió con una versión de software y luego se intenta recuperar con otra que no aprovecha bien las capacidades del hardware (por ejemplo, sin usar instrucciones AVX-512), el rendimiento baja mucho. Elegir algoritmos como LZ4 o Zstandard, que dan prioridad a la velocidad de descompresión, es una buena práctica para activos grandes.

Errores comunes en la gestión de archivos grandes

Uno de los fallos más habituales es ignorar las actualizaciones de software. Los fabricantes publican parches y paquetes acumulativos que mejoran la forma en que el sistema operativo o la base de datos manejan archivos grandes. Trabajar con versiones antiguas significa renunciar a mejoras que podrían reducir los tiempos de recuperación a la mitad.

Otro error frecuente es la mala gestión de permisos y auditorías. Si el sistema tiene que revisar permisos de acceso para cada bloque o sub archivo dentro de un activo muy grande durante la recuperación, la carga de procesamiento será enorme. Además, mantener activos “vivos” que ya deberían estar archivados aumenta sin necesidad el volumen de datos que el sistema tiene que manejar en una emergencia, lo que retrasa la recuperación de la información realmente crítica.

Cómo optimizar el rendimiento en la recuperación de archivos grandes

Para mejorar el rendimiento hace falta un cambio de enfoque: pasar de actuar solo cuando hay un problema a preparar el entorno de forma anticipada. No se trata solo de comprar hardware más rápido, sino de diseñar sistemas que trabajen de forma inteligente con los datos. Con buenas prácticas de diseño y uso adecuado de almacenamiento intermedio, se puede mejorar la eficiencia del sistema de forma notable.

Estrategias de diseño para sistemas de archivos y almacenamiento

El diseño debe empezar con un análisis del tipo de datos. Entender la estructura y el modelo permite organizar el almacenamiento para que los activos grandes se distribuyan de una forma lógica. Una técnica eficaz es la creación de particiones. Al dividir un activo enorme en partes más pequeñas (horizontales o verticales), el sistema puede realizar tareas de recuperación en paralelo, tratando cada partición como una unidad independiente.

También conviene definir bien las relaciones entre datos y usar tipos de datos adecuados. Evitar guardar objetos binarios grandes (BLOBs) dentro de tablas principales y moverlos a un sistema de almacenamiento de objetos reduce la carga del motor de base de datos. Así, la parte relacional se recupera antes, mientras los archivos pesados se cargan en segundo plano.

Elección de formatos y políticas de fragmentación

Para reducir la fragmentación lógica, se recomienda aplicar políticas de crecimiento manual. En lugar de dejar que un archivo crezca en pequeños aumentos automáticos, los administradores deberían prever la demanda y ampliar los archivos en bloques grandes y contiguos durante periodos de baja actividad. Esto baja mucho el número de segmentos que el sistema necesita seguir.

El formato de archivo también importa. Algunos están pensados para acceso aleatorio rápido, lo que permite recuperar solo partes concretas sin leer el archivo completo. En registros de transacciones, mantener un tamaño de VLF equilibrado (ni demasiado pequeño ni excesivamente grande) es una buena práctica técnica para reducir tiempos de análisis en la recuperación.

Uso de almacenamiento en caché y memoria intermedia

La caché es uno de los atajos más efectivos para ganar rendimiento. Implementar soluciones de caché en memoria, como Redis o Memcached, para los datos más consultados reduce el número de accesos al almacenamiento principal durante la recuperación. Para activos grandes distribuidos en varias regiones, usar redes de distribución de contenido (CDN) acerca los datos al punto donde se necesitan, reduciendo la latencia de red.

A nivel de servidor, configurar bien los búferes de memoria permite que el sistema operativo lea grandes bloques desde el disco y los mantenga listos para la CPU. Esto resulta muy útil en la reconstrucción de índices, donde se deben comparar y ordenar grandes volúmenes de información en poco tiempo. Una jerarquía de caché bien pensada permite que los datos fluyan sin interrupciones desde el soporte físico hasta la aplicación.

Optimización del hardware y de la red

Más allá de elegir SSD, la optimización del hardware pasa por configurar adecuadamente los controladores de almacenamiento y las interfaces. Usar NVMe over Fabrics (NVMe-oF) permite llevar el rendimiento del almacenamiento local a la red corporativa. En la red, activar tramas gigantes (Jumbo Frames) reduce la sobrecarga de cabeceras y permite que cada paquete transporte más datos reales.

También es buena idea usar tarjetas de red con funciones de descarga de procesamiento (Offloading), que se encargan de parte del trabajo de gestión del tráfico, liberando a la CPU principal para dedicarse a la recuperación y validación de datos. Aunque estas mejoras de hardware requieren inversión, se compensan pronto al reducir el tiempo de parada de servicios clave.

Supervisión y ajustes de las configuraciones del sistema

Sin mediciones no hay mejora posible. Herramientas como Azure Monitor o Application Insights ayudan a ver dónde se producen exactamente los cuellos de botella durante una recuperación. Ofrecen métricas en tiempo real sobre latencia de disco, uso de CPU y rendimiento de red, lo que permite a los técnicos hacer ajustes precisos en el momento adecuado.

El ajuste periódico de parámetros del sistema, como el tiempo de vida (TTL) de la caché o los umbrales de crecimiento automático, debe basarse en los datos recogidos por estas herramientas. La optimización es un ciclo continuo: supervisar, analizar, ajustar y volver a medir. Este enfoque asegura que el sistema esté siempre cerca de su mejor nivel de rendimiento para activos muy grandes.

Políticas recomendadas para la optimización del rendimiento de activos grandes

Para mantener un buen rendimiento a largo plazo, no basta con cambios técnicos puntuales; hace falta definir políticas claras a nivel organizativo. Estas políticas sirven de guía para los equipos de TI y ayudan a que la gestión de datos masivos siga buenas prácticas alineadas con las necesidades del negocio.

Implementar copias de seguridad incrementales y diferenciales

La política clave para activos grandes debe abandonar el enfoque de “solo backups completos”. Una estrategia que combine un backup completo semanal con backups diferenciales diarios e incrementales cada pocas horas reduce de forma drástica la cantidad de datos que hay que procesar cuando ocurre un fallo. En una restauración, el sistema solo tiene que aplicar los cambios desde el último punto de control, lo que acelera muchísimo el proceso.

Esta política debe incluir también la comprobación periódica de la integridad de las copias. Nada retrasa más que intentar recuperar un archivo grande y descubrir a mitad del proceso que la copia está dañada. Automatizar pruebas de restauración en entornos aislados garantiza que, cuando ocurra una emergencia real, los backups funcionen como se espera.

Automatizar purgado y archivado de archivos antiguos

El rendimiento de recuperación está muy ligado al volumen de datos activos. Una política de archivado agresiva mueve los datos poco consultados a un almacenamiento de archivo (más lento y barato), dejando el almacenamiento de alto rendimiento para los datos actuales y críticos. Menos datos activos significan índices más pequeños, menos metadatos y recuperaciones mucho más rápidas.

También hay que automatizar la limpieza de datos redundantes o temporales. Los activos grandes generan logs, archivos temporales y versiones antiguas que consumen espacio y recursos. Un sistema que borra automáticamente estos archivos siguiendo reglas definidas ayuda a mantener el entorno de almacenamiento limpio y listo para un rendimiento alto.

Balanceo de carga y distribución de recursos

Para evitar que la recuperación de un activo grande bloquee toda la infraestructura, conviene aplicar políticas de reparto de carga. Esto significa distribuir los activos gigantes entre diferentes servidores o nodos de almacenamiento, de modo que la recuperación de uno no compita por los mismos recursos que otros servicios en producción. Repartir bien la carga de I/O evita puntos calientes en el hardware.

El uso de réplicas de solo lectura también ayuda. Si las consultas de lectura se dirigen a una réplica y se reserva el servidor principal para escrituras y tareas de mantenimiento, se reduce la presión sobre el sistema principal. Durante una recuperación, estas réplicas pueden actuar como fuentes extra de datos y permitir una restauración en paralelo que use todo el ancho de banda disponible.

Revisión periódica de la gestión de permisos y accesos

Una estructura de permisos demasiado detallada puede frenar la vuelta a la disponibilidad. Si el sistema tiene que revisar miles de entradas de control de acceso (ACL) para cada activo grande al ponerlo en línea, se suma un costo extra innecesario. Es mejor simplificar permisos con grupos y roles heredados y reducir las excepciones específicas por archivo.

Revisar de forma periódica quién tiene acceso a qué datos también ayuda a mejorar tanto la seguridad como el rendimiento. Cuantas menos cuentas con permisos innecesarios, menos verificaciones son necesarias durante las auditorías del sistema de archivos. Una gestión de accesos ordenada y clara aporta un beneficio silencioso pero importante al rendimiento general.

Soluciones alternativas para mejorar la recuperación de archivos grandes

Cuando las políticas habituales y el hardware estándar no bastan, es hora de mirar soluciones tecnológicas más avanzadas. Estas opciones suelen requerir cambios en la arquitectura de datos o la adopción de nuevas tecnologías que abordan el problema de la lentitud desde otros ángulos.

Sistemas de deduplicación y compresión avanzada

La deduplicación de datos identifica y elimina bloques repetidos dentro de un sistema de almacenamiento. Para activos grandes, esto puede reducir el espacio ocupado hasta en un 80%, lo que acelera la recuperación porque hay menos datos físicos que leer. Al restaurar un archivo, el sistema vuelve a armarlo a partir de bloques únicos ya almacenados.

En compresión, algoritmos modernos como Brotli o Zstandard ofrecen muy buenas tasas de compresión con una descompresión muy rápida. Están pensados para aprovechar el procesamiento paralelo de las CPUs actuales, de modo que la fase de descompresión no se convierta en el cuello de botella al recuperar activos masivos.

Migración de datos a infraestructuras escalables o cloud

En algunos casos, la mejor opción es dejar de gestionar el hardware en local. Migrar activos grandes a infraestructuras en la nube permite usar recursos de cómputo y almacenamiento que serían muy caros de mantener en una instalación propia. Las plataformas cloud ofrecen almacenamiento de objetos con redundancia integrada y funciones de recuperación ante desastres que se pueden activar con muy pocos pasos.

Esta migración también facilita el uso de bases de datos distribuidas, donde los datos no están en un solo archivo enorme, sino repartidos en varios nodos a nivel global. Esto no solo mejora la velocidad de recuperación gracias al procesamiento paralelo a gran escala, sino que también aumenta la resistencia del sistema frente a fallos en una región concreta.

Implementación de tecnologías SSD y almacenamiento NVMe

Aunque ya se ha mencionado, un uso más amplio de NVMe (Non-Volatile Memory Express) es una de las soluciones más eficaces. A diferencia de SATA o SAS, NVMe está pensado específicamente para memorias no volátiles y ofrece miles de colas de comandos con una latencia muy baja. Para la recuperación de activos grandes, esto permite que el sistema pida y reciba miles de bloques de datos al mismo tiempo.

Si se combina con almacenamiento persistente de clase memoria (como Intel Optane u opciones similares), se reduce casi por completo la diferencia entre RAM y almacenamiento. Estos dispositivos funcionan como una extensión de la memoria principal y permiten que la recuperación de metadatos y estructuras de archivos grandes se haga a velocidades que antes no eran posibles.

Optimizar consultas y procesos de restauración

A nivel de software, mejorar las consultas de base de datos ofrece resultados muy buenos sin necesidad de cambiar el hardware. Reescribir consultas para evitar uniones innecesarias, usar índices de cobertura y limitar la cantidad de datos devueltos reduce mucho la carga durante la recuperación. El uso de vistas materializadas permite guardar de antemano resultados complejos y ayuda a que el sistema vuelva a operar antes.

En restauración, usar técnicas de “restauración por piezas” (Piecemeal Restore) permite poner en línea primero las partes más críticas de una base de datos o sistema de archivos y dejar el resto para después. De esta forma, el negocio puede retomar sus funciones esenciales en pocos minutos, mientras la recuperación del resto de datos continúa en segundo plano sin afectar la productividad.

Preguntas frecuentes sobre la recuperación lenta y la optimización de archivos grandes

A continuación se responden algunas dudas habituales sobre problemas de rendimiento en la gestión de activos de gran tamaño. El objetivo es ofrecer respuestas claras y útiles para administradores de sistemas y responsables de datos.

¿Cómo saber si el problema es por el tamaño del archivo o por la red?

Para distinguirlo, conviene hacer pruebas aisladas. Si la lectura local del archivo en el servidor de origen es rápida, pero la transferencia al destino es lenta, el problema suele estar en la red. Herramientas de diagnóstico pueden mostrar latencias altas o congestión. En cambio, si el servidor de origen tarda mucho en empezar a enviar datos (una fase de análisis muy larga), el problema está en la estructura interna del archivo o en la fragmentación del almacenamiento local.

¿Cuándo es necesario considerar una solución de almacenamiento nueva?

Hay que valorar una nueva solución cuando los ajustes de software dejan de mejorar el rendimiento y el hardware actual trabaja casi siempre al 100% de su capacidad de I/O en condiciones normales. Si los tiempos de recuperación superan los Acuerdos de Nivel de Servicio (SLA) que exige el negocio y la infraestructura no permite crecer de forma sencilla, es momento de pensar en tecnologías más modernas como NVMe o almacenamiento definido por software (SDS).

¿Qué herramientas permiten monitorizar la recuperación de archivos grandes?

Depende del entorno. Para bases de datos, los monitores de actividad incluidos (como los de SQL Server Management Studio) muestran detalles de los pasos de recuperación. Para sistemas de archivos en general, herramientas como Resource Monitor en Windows o `iostat` y `nmon` en Linux ofrecen datos claros sobre uso de disco y red. A nivel corporativo, soluciones como Nagios, Zabbix o Datadog permiten crear alertas basadas en métricas de rendimiento específicas para activos grandes.

Recomendaciones finales para garantizar un rendimiento alto en la recuperación de activos grandes

La recuperación de activos grandes es un reto que cambia con el tiempo. A medida que crecen los volúmenes de datos por el uso de aprendizaje profundo y análisis masivo, los requisitos de rendimiento seguirán aumentando. Por ello, la recomendación principal es adoptar una cultura de mantenimiento preventivo. No espere a que ocurra un fallo para descubrir que su registro de transacciones está muy fragmentado o que una restauración completa tarda días. Haga revisiones de rendimiento trimestrales y mantenga estadísticas de uso y crecimiento siempre al día.

Otra recomendación importante es la capacitación continua. El personal técnico debe conocer las novedades en sistemas de archivos, compresión y almacenamiento. Tecnologías que hoy parecen experimentales, como el almacenamiento en ADN o ciertos sistemas de archivos avanzados, pueden convertirse en estándar en unos años. Estar preparado para integrarlas puede marcar la diferencia entre una empresa que se recupera en minutos y otra que permanece parada semanas.

Por último, incluya siempre la seguridad como parte del rendimiento. Un sistema rápido pero inseguro no sirve, igual que uno muy seguro pero lento. Use cifrado acelerado por hardware y políticas de acceso simples que no añadan trabajo innecesario al proceso de recuperación. Al equilibrar velocidad, integridad y seguridad, podrá construir una infraestructura resistente capaz de manejar cualquier volumen de datos, por grande que sea, con alta eficiencia.